Можно ли выиграть суд с искусственным интеллектом?

Можно ли выиграть суд с искусственным интеллектом? На этот вопрос мы попытаемся ответить в нашем новом материале.

В последние годы всё больше людей, столкнувшихся с юридической проблемой, приходят к одному и тому же соблазнительному выводу: зачем платить адвокату, если есть искусственный интеллект? Подать апелляцию, составить ходатайство, оформить иск, подготовить возражение на претензию — со всем этим, казалось бы, справится умный чат-бот. Быстро, бесплатно и без записи на приём за две недели. ИИ не устаёт, не опаздывает и не выставляет счёт за каждый телефонный звонок. На фоне раздутых адвокатских гонораров это выглядит как настоящая революция в доступе к правосудию. Неудивительно, что миллионы людей по всему миру уже попробовали именно так решить свои юридические вопросы.

Особенно вдохновляет тех, кто задумывается, а не поручить ли свои юридические дела умной машине, история обычного немца по имени Дэвид Хинц, о которой весь мир узнал совсем недавно. Герр Хинц оказался в крайне неприятной ситуации: он нашёл новую работу на неделю раньше запланированного и честно сообщил об этом в агентство по безработице. Однако работодатель неожиданно стал отрицать осведомлённость о его трудоустройстве в указанные сроки. Агентство не только потребовало вернуть уже выплаченное пособие за последнюю неделю (около €242), но и выписало штраф в размере €500, обвинив Хинца в мошенничестве. Дело дошло до окружного суда Лейпцига.

Хинц не стал нанимать адвоката. Вместо этого он провёл за разговором с ChatGPT несколько часов, подробно описывая всё, что произошло: хронологию событий, переписку с работодателем, коммуникацию с агентством, все детали, которые казались ему важными. ИИ систематизировал информацию, сформулировал правовую позицию и подготовил итоговый документ объёмом восемнадцать страниц. Хинц подал его в суд самостоятельно и суд удовлетворил его требования. Штраф был отменён, обвинение в мошенничестве снято, деньги возвращать не пришлось.

Можно ли выиграть суд с искусственным интеллектом?

История красивая. Вдохновляющая. И она абсолютно реальна, поскольку Хинц действительно одержал верх над системой. Именно такие истории разлетаются по социальным сетям, именно они убеждают тысячи людей, что юридическая профессия устарела, а чат-бот вполне способен заменить живого специалиста. Один человек справился, значит, справлюсь и я. Логика понятна. Но достаточно ли она надёжна, чтобы ставить на неё исход важного дела?

Так ли эффективен ИИ в реальных судебных процессах, или история Хинца скорее исключение, чем правило? Где проходит граница между задачей, с которой машина справится блестяще, и ситуацией, в которой она подведёт вас в самый ответственный момент? И главное, чем рискует человек, который доверяет алгоритму то, что требует живого профессионального опыта?

В этом материалы мы попытались собрать для вас наиболее полную картину: с реальными примерами, именами, суммами штрафов и закрытыми навсегда делами. После прочтения вы сможете сделать для себя правильный вывод и ответить на главный вопрос: «Можно ли выиграть суд с искусственным интеллектом, если, по статистике, эффективность ИИ в таких вопросах составляет от 60 до 73%. Поручите ли вы ему важное дело, от которого зависит ваше будущее, и станет ли искусственный интеллект вашим спасением или же самой дорогой ошибкой в жизни…»

Латис Джонс против Delta Airlines: когда ИИ ничем не рискует

Эта история началась как вполне человеческая трагедия. Латис Джонс проработала оператором службы поддержки клиентов в Delta Airlines с октября 2012 года — почти двенадцать лет. Затем она подала иск, обвинив авиакомпанию в дискриминации по религиозному признаку, расовой принадлежности и инвалидности, указав в качестве последней длительный ковид, тревожное расстройство и дисфункцию тазового дна. Звучит как история человека, которому действительно причинили вред и который решился на борьбу. Жаль, что борьбу он доверил не тому, кому следовало.

Джонс подала иск самостоятельно: в американском праве это называется pro se, то есть представление собственных интересов без адвоката. Роль юридического советника она отдала ChatGPT: по имеющимся данным, чат-бот помогал ей разобраться, «как действовать с юридической точки зрения», и она прямо заявляла, что считает его своим адвокатом. Это было первой и фатальной ошибкой — не тактической, а концептуальной. ChatGPT не является адвокатом. Он не несёт за вас ответственности. Он не знает вашего конкретного дела. И он не предупредит вас о том, чего не знает сам.

Суд проявил к Джонс значительное терпение: сроки сбора доказательств продлевались не единожды. Тем не менее к январю 2026 года, когда этап discovery официально завершился, предоставить весомые подтверждения своим обвинениям она так и не смогла. И здесь проявляется первый принципиальный изъян ИИ как «адвоката»: он может объяснить, какие доказательства нужны в теории, но он не умеет их собирать, не умеет выстраивать доказательную базу в реальном времени и не чувствует, где именно в вашем деле находится слабое место, которое противник обязательно атакует.

Развязка наступила на допросе. Адвокаты Delta заметили, что Джонс постоянно обращается к ноутбуку. Когда её напрямую спросили, не вводит ли она происходящее в ChatGPT прямо сейчас — она отказалась отвечать, сославшись на адвокатскую тайну. Этот момент стал, пожалуй, самым красноречивым во всей истории. Адвокатская тайна — это привилегия, защищающая конфиденциальные коммуникации между клиентом и его лицензированным адвокатом.

Суды уже подтвердили: ChatGPT не является адвокатом, не несёт никаких обязательств конфиденциальности и не может формировать отношения адвокат-клиент. Любая информация, переданная чат-боту, потенциально доступна в рамках судебного раскрытия доказательств. Джонс применила юридический термин, которому её научил ИИ в ситуации, где этот термин был абсолютно неприменим. Это не юридическая защита. Это её иллюстрация.

Можно ли выиграть суд с искусственным интеллектом?

Вторым нарушением стала тайная аудиозапись допроса без разрешения суда, что само по себе способно уничтожить позицию в деле, поскольку нарушает процессуальные правила и может повлечь исключение доказательств. Опытный адвокат никогда не допустил бы ни того, ни другого. Он знает, что можно делать в зале суда, а что категорически нет. ChatGPT, судя по всему, этого объяснить не смог. Или объяснил недостаточно убедительно. Или объяснил, но не в тот момент.

Итог оказался окончательным: суд удовлетворил ходатайство Delta об отклонении иска, и будущие жалобы против авиакомпании по тем же основаниям рассматриваться не будут. Не просто проигрыш, а закрытая дверь навсегда. Двенадцать лет работы, реальные обвинения в дискриминации, которые суд так и не рассмотрел по существу и полный процессуальный крах. Не потому что дело было безнадёжным. А потому что рядом не было человека, который умеет играть по правилам этой игры.

История Латис Джонс — это не история о том, что ИИ плохой. Это история о том, что у каждого инструмента есть своя область применения. Скальпель — превосходный инструмент, но в руках пациента, который оперирует себя сам, опираясь на статьи из Википедии. ChatGPT способен объяснить вам, как устроена правовая система, но выиграть дело в суде — это другая профессия. И она требует живого человека, который несёт за результат личную ответственность.

Эффективность ИИ в судебных делах (19 кейсов, объясняющих всё)

Теория — это хорошо. Но ничто не убеждает лучше, чем реальные истории реальных людей, которые заплатили за свои ошибки реальную цену. Мы собрали 19 задокументированных случаев из США, Великобритании и Канады, где слепое доверие к искусственному интеллекту в судебных делах обернулось штрафами, отклонёнными исками, дисциплинарными санкциями и разрушенными карьерами. Читайте внимательно.

- Mata v. Avianca — США, Нью-Йорк, 2023

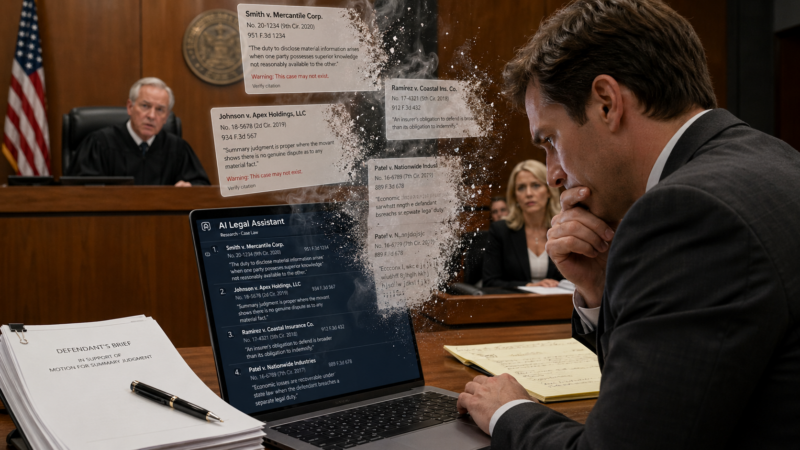

Опытный адвокат Стивен Шварц с тридцатилетним стажем использовал ChatGPT для подготовки возражения на ходатайство авиакомпании Avianca. ИИ услужливо предоставил шесть судебных прецедентов с убедительными названиями, номерами дел и цитатами судей. Все они были выдуманы от первого до последнего слова. Когда суд и противная сторона не смогли найти эти дела ни в одной базе данных, Шварц снова обратился к ChatGPT — и тот с той же уверенностью подтвердил их существование и даже прислал «тексты решений». Многостраничные, юридически грамотные и абсолютно фиктивные.

Судья Кевин Кастел назвал произошедшее «беспрецедентным» и оштрафовал адвокатов на $5 000, вынес публичное порицание и обязал их разослать копию постановления всем судьям, чьи имена ChatGPT ложно указал авторами фальшивых решений. Иск был отклонён. Это дело стало точкой отсчета в таких вопросах, ведь именно после него суды по всему миру начали вводить специальные правила об использовании ИИ в процессуальных документах.

- Harber v. HMRC — Великобритания, 2023

Гражданка Фелисити Харбер решила самостоятельно оспорить штраф британской налоговой службы HMRC по налогу на прирост капитала. Чтобы подкрепить свою позицию, она предоставила трибуналу девять судебных решений, в которых налогоплательщикам якобы удавалось избежать аналогичных штрафов. Судья начал проверку и не обнаружил ни одного из этих дел в английском праве. Выяснилось, что документы были сгенерированы ИИ и не имели отношения к реальной судебной практике.

Трибунал отклонил апелляцию, оставил штраф в силе и особо отметил, что предоставление вымышленных прецедентов не просто бесполезно — оно вредит самому заявителю, поскольку отнимает время суда и подрывает доверие к его позиции. Харбер, по всей видимости, искренне верила, что ИИ помогает ей защититься. На практике он помог ей проиграть быстрее.

- Майкл Коэн и Google Bard — США, 2024

Майкл Коэн — бывший личный адвокат Дональда Трампа, человек, проведший годы в залах суда, использовал Google Bard для поиска прецедентов в поддержку ходатайства о досрочном прекращении своего испытательного срока после выхода из тюрьмы. Bard предоставил список дел, которые выглядели вполне реальными. Коэн передал их своему адвокату, тот включил их в официальное ходатайство, не удосужившись проверить. Судья быстро установил, что ни одно из упомянутых дел не существует.

Судья Джесси Фурман не стал налагать серьёзные санкции, приняв во внимание, что Коэн искренне считал Bard «усиленным поисковиком», а не генеративным ИИ и не понимал, что тот способен сочинять несуществующие факты. Ходатайство было отклонено, инцидент попал во все мировые СМИ. Показательная деталь: даже человек, проработавший в юриспруденции десятилетия, не распознал разницу между поиском информации и её генерацией.

- Kruse v. Karlen — США, Миссури, 2024

Это один из самых показательных случаев именно потому, что человек представлял себя сам без адвоката, с ИИ в роли советника. Ответчик подал апелляционную жалобу, опираясь на судебные прецеденты, найденные с помощью искусственного интеллекта. Апелляционный суд Миссури проверил все 24 цитаты, упомянутые в жалобе. Реальными оказались ровно две.

Можно ли выиграть суд с искусственным интеллектом?

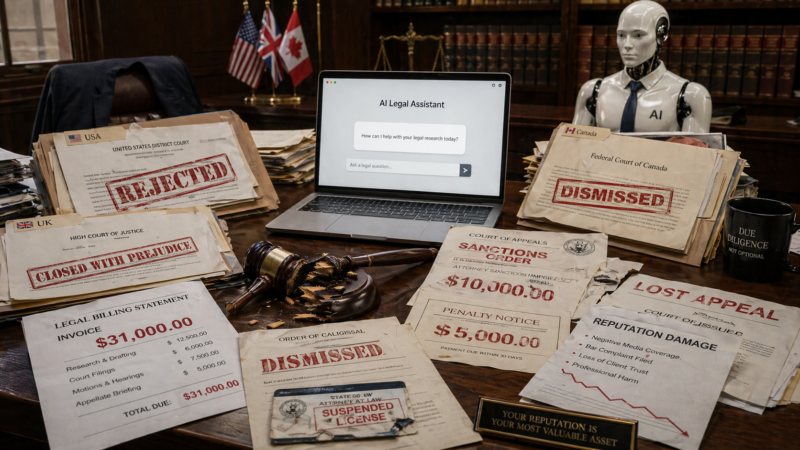

Итог был закономерным и жёстким: апелляция отклонена как несостоятельная, заявитель оштрафован на $10 000 за подачу необоснованной жалобы с использованием заведомо ложных данных. Суд также обязал его разослать копию постановления своим нынешним клиентам. Человек хотел сэкономить на адвокате, но заплатил десять тысяч долларов за чужие выдумки.

- Zhang v. Chen — Канада, Британская Колумбия, 2024

Семейные споры о праве посещения детей — одна из самых эмоционально заряженных категорий дел, где цена ошибки измеряется не деньгами, а временем, проведённым с собственным ребёнком. Адвокат одного из родителей использовал ChatGPT для подготовки аргументов и включил в документы два судебных прецедента. Противная сторона потратила значительные средства на юристов, которые пытались найти эти дела в базах данных, но безрезультатно. Прецеденты были полностью выдуманы.

Судья принял решение, которое стало прецедентом само по себе: адвокат был обязан лично, из собственного кармана, возместить все расходы противоположной стороны, понесённые при проверке фейковых ссылок. Не фирма, не клиент — именно адвокат. Это прямое и болезненное напоминание о том, что профессиональная ответственность не делегируется машине.

- Park v. Kim — США, Второй апелляционный округ, 2024

Дело изначально было проиграно из-за нарушений процессуальных норм и проблем с раскрытием доказательств — ИИ здесь был не единственной причиной катастрофы, но стал её финальным аккордом. На стадии апелляции адвокат сослался на судебный прецедент, сгенерированный ChatGPT, которого не существовало в природе. Апелляционный суд подтвердил первоначальное решение и дополнительно передал материалы в дисциплинарный орган для проверки действий адвоката.

Этот случай особенно поучителен тем, что показывает кумулятивный эффект ошибок: дело уже висело на волоске, и единственное, что требовалось от адвоката — не совершить новых промахов. Вместо этого он добавил к процессуальным нарушениям ещё и фиктивный прецедент, превратив проигрыш в профессиональное дисциплинарное разбирательство.

- J.G. v. NYC Department of Education — США, 2024

Здесь история немного другая — ИИ не придумывал несуществующих прецедентов, но его использование всё равно обошлось клиенту дорого. Юридическая фирма Cuddy Law применила ChatGPT для обоснования размера адвокатского гонорара, который она намеревалась взыскать с Департамента образования Нью-Йорка в рамках дела о правах ребёнка на специальное образование. ИИ сгенерировал аргументы в пользу запрошенных ставок, но суд их отверг.

Судья прямо указал, что выводы ChatGPT относительно рыночных ставок адвокатских гонораров не являются надлежащим доказательством и не могут использоваться вместо реальных данных о рынке юридических услуг. В итоге фирма получила около $53 000 вместо запрошенных почти $100 000 — почти вдвое меньше. Урок прост: суд оценивает доказательства, а не распечатки из чат-бота.

Можно ли выиграть суд с искусственным интеллектом?

- Noland v. Land of the Free — США, Калифорния, 2025

Трудовой спор, проигранный на стадии предварительного рассмотрения, казалось, ещё мог быть спасён апелляцией. Адвокат взялся за подготовку апелляционного документа и, судя по всему, доверил значительную его часть ChatGPT без надлежащей проверки. Суд обнаружил, что 21 из 23 цитат в документе были либо полностью выдуманы, либо содержали грубые фактические ошибки.

Суд не просто наложил штраф в $10 000, но и отказал в праве подать исправленный бриф. То есть возможности исправить ошибку не было предоставлено вовсе. Дело закрыто. Клиент потерял шанс на апелляцию не потому, что его позиция была слабой, а потому что инструмент, которому доверили её изложение, не имел ни малейшего представления о том, какие дела реально существуют в калифорнийских судах.

- Couvrette v. Wisnovsky — США, Орегон, 2025–2026

Пожалуй, самое финансово разрушительное дело в нашем списке. В нескольких процессуальных документах истцов суд обнаружил 15 фальшивых судебных ссылок и 8 выдуманных цитат из якобы реальных решений. Адвокат объяснил это использованием генеративного ИИ. Суд не принял объяснение как смягчающее обстоятельство.

Последствия оказались катастрофическими: все требования истцов отклонены с так называемым prejudice, то есть без права когда-либо снова подать те же требования в суд. Штраф составил $15 500. Дополнительно суд взыскал в пользу ответчика расходы на юридическую защиту в размере около $94 704. Итого цена доверия к ИИ без проверки — больше ста десяти тысяч долларов и полная утрата правовой позиции.

- Williams v. Honl — США, Орегон, 2026

Иск о диффамации — категория дел, где репутация и доказательная база критически важны. Адвокат подготовил процессуальный документ, призванный помочь возобновить разбирательство, с помощью генеративного ИИ. Документ содержал сфабрикованные цитаты и непроверенные правовые утверждения. Суд исключил документ из дела целиком.

Помимо процессуального ущерба, суд взыскал с проигравшей стороны около $8 000 в счёт расходов ответчика. Дело, которое имело шансы на продолжение, было фактически заблокировано на процессуальном уровне — не по существу, а из-за качества документа. Именно это и есть самый болезненный сценарий: проиграть не потому, что вы неправы, а потому что ваш «помощник» написал за вас ерунду.

- Дело против Fenix International (OnlyFans) — США, 2025

Известная юридическая фирма Hagens Berman — не новички и не самоучки. Она подала серию документов против материнской компании платформы OnlyFans. В документах были обнаружены характерные следы ИИ-галлюцинаций: вымышленные или искажённые правовые материалы, которые не выдержали проверки судом. Штраф составил $13 000, а ходатайства ответчиков об отклонении дела были удовлетворены.

Важная деталь: суд отдельно отказал в просьбе просто отозвать или исправить проблемные документы, то есть «тихо» выйти из ситуации не получилось. Это прецедент для всей отрасли: крупная фирма с репутацией, работающая на резонансном деле, публично опозорилась из-за непроверенного машинного текста. Репутационный ущерб здесь, вероятно, превышает финансовый.

- Ayinde v. London Borough of Haringey и Al-Haroun v. Qatar National Bank — Великобритания, 2025

Высокий суд Англии и Уэльса в течение одного периода рассмотрел два отдельных дела с одинаковой проблемой. В деле Ayinde против Лондонского совета Харингей в материалах обнаружилось пять фальшивых судебных ссылок. В деле Al-Haroun против Катарского национального банка картина оказалась масштабнее: 18 из 45 приведённых ссылок были полностью выдуманы.

Суд не ограничился санкциями и выступил с развёрнутым предупреждением для всей юридической профессии: подобные действия могут квалифицироваться не только как основание для дисциплинарного разбирательства и передачи дела регулятору, но и в серьёзных случаях как неуважение к суду. В британской правовой традиции это не просто штраф, это угроза лишения свободы. Градус серьёзности, с которым суды воспринимают проблему, становится всё выше.

Можно ли выиграть суд с искусственным интеллектом?

- Адвокат из Денвера — приостановка лицензии — США, Колорадо

Этот случай примечателен не масштабом финансовых потерь, а последствием, которого боится каждый юрист: потерей права практиковать. Адвокат из Денвера использовал ChatGPT для подготовки процессуального документа, который содержал фиктивные ссылки. Когда обман вскрылся, выяснилась ещё одна деталь: в переписке с помощником адвокат сам писал, что не проверил текст и назвал себя при этом идиотом.

Верховный суд Колорадо назначил 90-дневную приостановку адвокатской лицензии. Не штраф, а именно приостановку. Три месяца без права работать, без дохода, с публичной записью в дисциплинарном реестре, которая остаётся там навсегда. Это та цена, которую платят не клиенты, а сами юристы, когда решают, что проверять за машиной необязательно.

- Адвокат из Аризоны — санкция за 12 из 19 фейковых цитат — США, Аризона, 2024

Апелляция по делу об отказе в пособии по социальному страхованию — категория дел, где на кону стоят деньги и здоровье реального человека, часто пожилого или нетрудоспособного. Адвокат подготовил апелляционный бриф, в котором из 19 цитат 12 оказались сфабрикованными — с несуществующими именами судей, несуществующими номерами дел и несуществующими решениями. Судья Элисон Бачус описала документ как «пронизанный нарушениями, характерными для галлюцинаций искусственного интеллекта».

Санкции были наложены, дело получило огласку и попало в международную базу данных AI Hallucination Cases, которую ведёт исследователь Дамьен Шарлотен из HEC Paris. На сегодняшний день в этой базе более шестисот задокументированных случаев по всему миру. Аризона входит в топ юрисдикций по числу подобных инцидентов, уступая лишь Южному округу Флориды.

- Адвокат Mostafavi — США, Калифорния, 2025

Дело адвоката Мостафави стало рекордным для судов Калифорнии на момент вынесения решения. В апелляционной жалобе по гражданскому делу из 23 цитат 21 оказалась полностью выдумана ChatGPT. Суд не только наложил штраф в $10 000, но и сопроводил решение развёрнутым и жёстким мнением, в котором указал, что многочисленные суды по всей стране уже неоднократно предупреждали адвокатов об этой проблеме.

Сам Мостафави в интервью после вынесения решения сказал нечто неожиданно честное: чем труднее юридический аргумент, тем активнее ИИ будет галлюцинировать, потому что модель стремится угодить запросу и найти подтверждение желаемому. Это называется предвзятостью подтверждения, встроенной в архитектуру языковой модели. Машина не ищет правду — она ищет правдоподобие.

- MyPillow (Майк Линделл) — США, Колорадо, 2025

Майк Линделл — основатель MyPillow и известный публичный деятель, судился по делу о диффамации. Его адвокаты подготовили процессуальный документ с помощью ИИ и подали его в суд, не проведя надлежащей проверки. Документ оказался переполнен ошибками и ссылками на несуществующие дела. Федеральный судья оштрафовал обоих адвокатов по $3 000 каждого.

Эксперты, комментировавшие это дело, назвали санкции «относительно мягкими с учётом масштаба нарушений» и предупредили, что суды становятся всё менее терпимыми к подобным объяснениям. Для Линделла это дело добавило публичного конфуза к уже непростой репутации. Для его адвокатов — финансовых и репутационных потерь, которые никакой гонорар не компенсирует.

- Дело о травме в Walmart — США, 2024

Иск о личной травме, полученной в магазине Walmart. Казалось бы, рядовое дело, каких в американских судах тысячи в год. Три адвоката истца подготовили процессуальные документы с использованием ИИ и включили в них фиктивные прецеденты. Суд обнаружил подлог и оштрафовал всех троих на $5 000 суммарно.

Примечательно, что это именно та категория дел, где реальных прецедентов предостаточно — американские суды рассматривают тысячи исков о травмах в торговых сетях ежегодно. Адвокатам не нужно было обращаться к ИИ за прецедентами: они были в открытом доступе. Это говорит о том, что проблема не всегда в отсутствии ресурсов — иногда это просто привычка делегировать машине то, что требует человеческого внимания.

- Две калифорнийские фирмы — штраф $31 000 — США, Калифорния

Этот случай выделяется на общем фоне по одной причине: адвокаты использовали не просто ChatGPT, а специализированные юридические инструменты — Google Gemini в связке с Westlaw Precision, платформой, созданной специально для профессионального правового поиска. Тем не менее итоговый документ содержал фейковые цитаты, которые не выдержали судебной проверки. Судья подверг критике не только сам факт ошибок, но и то, что использование ИИ не было раскрыто суду.

Можно ли выиграть суд с искусственным интеллектом?

Штраф в $31 000 стал одним из крупнейших в Калифорнии по этой категории дел. Но важнее финансовой стороны — принципиальный вывод: даже «юридический» ИИ галлюцинирует. Специализация инструмента снижает риск, но не устраняет его. Профессиональная ответственность за каждое слово в документе остаётся за человеком, чья подпись стоит внизу.

- Johnson v. Dunn — США, Алабама, 2025

Последнее дело в нашем списке и, пожалуй, самое тревожное. Не потому что последствия были самыми тяжёлыми, а потому что речь идёт о крупной уважаемой юридической фирме, которая заблаговременно и добросовестно приняла меры против злоупотребления ИИ. Фирма разослала всем сотрудникам предупреждение об опасности генеративного ИИ в рабочих документах. Фирма запретила использование ИИ без разрешения руководителей практики. И всё равно — именно руководитель одной из практик вставил в ходатайство галлюцинацию ChatGPT.

Суд наложил санкции, но смягчил их, приняв во внимание добросовестную политику фирмы. Однако вывод из этого дела звучит не обнадёживающе, а предостерегающе: если даже в структуре с правилами, обучением и контролем это происходит — значит, проблема системная. Искусственный интеллект умеет убеждать. Он убеждает не только клиентов без юридического образования — он убеждает опытных профессионалов, которые должны были знать лучше.

Статистика успеха ИИ в юридических делах, о которой мало кто знает

Первое, что делает человек, решивший сэкономить на адвокате и довериться искусственному интеллекту — ищет подтверждение своему решению. Отвечая на вопрос „Можно ли выиграть суд с искусственным интеллектом?” пытается искать ответы в историях успеха, вдохновляющих кейсах, на форумах с восторженными отзывами. Но есть вопрос, который никто не задаёт вслух: а какова реальная статистика использования ИИ в судебных делах? Сколько людей выиграли, сколько проиграли, и что именно пошло не так у тех, кто проиграл? Мы попытались найти ответ. И то, что обнаружили, говорит само за себя — даже без красивых круговых диаграмм.

Начнём с честного признания: единой мировой статистики побед и поражений в делах, которые люди вели с помощью ИИ вместо адвоката, пока не существует. Суды большинства стран не требуют от участников процесса раскрывать, использовали ли они искусственный интеллект при подготовке документов. Никто не ведёт реестр «дел, выигранных с ChatGPT». Это само по себе показательно: индустрия, которая громко рекламирует свои возможности, не располагает и не спешит формировать доказательную базу своей эффективности в суде. Зато существует обратная статистика и она весьма красноречива.

Исследователь Дамьен Шарлотен из парижской бизнес-школы HEC ведёт базу данных AI Hallucination Cases — публичный реестр судебных дел, в которых суд был вынужден разбираться с последствиями использования искусственного интеллекта. По состоянию на апрель 2026 года в базе зафиксировано 1 353 дела. Важно понимать, что это не все случаи использования ИИ в судах — это только те случаи, где проблема стала достаточно серьёзной, чтобы суд её публично зафиксировал. Иными словами, это база пойманных катастроф, а не полная картина. Реальное число дел, в которых ИИ создал незамеченные ошибки, никто не считал.

Особенно тревожные данные получили исследователи Университета Нового Южного Уэльса в Австралии. Они проанализировали 84 опубликованных случая использования генеративного ИИ в австралийских судах с момента запуска ChatGPT до сентября 2025 года. Результат: в 66 из 84 случаев, то есть более чем в трёх четвертях, фигурировали люди, представлявшие себя в суде самостоятельно, без адвоката. Именно та категория людей, которая наиболее склонна доверять ИИ как замене юридической помощи. И именно та категория, которая чаще всего попадает в базу судебных проблем с искусственным интеллектом. Совпадение? Вряд ли.

Теперь перейдём к цифре, которая должна остановить любого, кто собирается доверить ИИ подготовку юридических документов без профессиональной проверки. Исследователи Стэнфордского университета протестировали точность различных ИИ-инструментов на юридических запросах. Вывод оказался неутешительным: обычные чат-боты — такие как стандартный ChatGPT — давали ошибочную или галлюцинированную информацию в 58–82% случаев при юридических запросах. Не в редких исключительных ситуациях — в большинстве случаев. Это означает, что если вы задаёте обычному чат-боту вопрос о своём правовом положении, шанс получить недостоверный ответ статистически выше, чем шанс получить верный.

Можно ли выиграть суд с искусственным интеллектом?

Но, возможно, специализированные юридические ИИ-инструменты надёжнее? Отчасти — да. Стэнфордские исследователи зафиксировали, что профессиональные платформы ошибаются реже. Но «реже» не означает «надёжно». Lexis+ AI и Ask Practical Law AI давали неверную информацию более чем в 17% запросов. Westlaw AI-Assisted Research — флагманский продукт одной из крупнейших юридических баз данных мира — галлюцинировал более чем в 34% случаев. Представьте хирурга, который ошибается в каждой третьей операции. Или пилота, который в каждом пятом полёте путает показания приборов. В авиации и медицине такой процент ошибок означал бы немедленный запрет профессии. В юриспруденции он означает штрафы, проигранные дела и закрытые навсегда возможности.

Отдельного внимания заслуживают исследования точности ИИ в прогнозировании судебных решений — область, которую разработчики любят упоминать как доказательство юридических способностей машины. Да, существуют модели, которые предсказывали исходы дел Европейского суда по правам человека с точностью около 79%, а решения Верховного суда США — с точностью около 70%. Звучит впечатляюще. Но это не имеет никакого отношения к вашему конкретному делу. Модель анализировала исторические данные и угадывала статистически вероятный исход — она не строила стратегию, не подавала документы, не общалась с судьёй и не несла никакой ответственности за результат. Это примерно как сказать, что метеоролог, угадывающий погоду в 70% случаев, способен остановить ураган.

Есть и ещё один аспект, о котором не принято говорить открыто. Успешное использование ИИ в суде — тихое. Человек подготовил документы, выиграл дело, никто не заметил участия чат-бота — история не попала ни в одну базу данных. Провальное использование ИИ — громкое. Фиктивные ссылки, санкции, публичные постановления, журналистские материалы, академические исследования. Это означает, что вся доступная нам статистика систематически смещена в сторону катастроф: мы видим только тех, кто упал, и не видим тех, кто устоял. Если даже с этой поправкой на смещение цифры выглядят тревожно — реальная картина рисков ещё серьёзнее, чем показывают данные.

Единственная коммерческая платформа, которая публично заявляет о проценте успеха, — американский сервис Courtroom5, помогающий людям вести дела без адвоката. По их собственным данным, 73% пользователей, доведших дело до финала, выиграли или заключили мировое соглашение. Но здесь важен каждый нюанс: это данные самой платформы, а не независимого исследования. «Выиграли или заключили соглашение» — принципиально разные исходы. В статистику не включены те, кто бросил дело на полпути. И самое главное: никто не знает, что именно повлияло на результат — ИИ, личные обстоятельства дела, позиция судьи или простое везение. Это не статистика надёжности. Это маркетинговый показатель.

Итог всей этой картины можно сформулировать коротко. Надёжных данных о том, что ИИ помогает выигрывать судебные дела, не существует. Зато существуют тысячи задокументированных случаев, где он помог их проиграть — через фиктивные прецеденты, пропущенные сроки, процессуальные ошибки и галлюцинированные цитаты. Инструмент, который ошибается в каждом третьем юридическом запросе даже в своей профессиональной версии, — это не адвокат. Это черновик, который обязательно нужно проверить. И проверить должен человек, который понимает разницу между тем, что написано в законе, и тем, что происходит в реальном зале суда.

Адвокат — не роскошь, а контроль качества ИИ

Если вы дочитали до этого места — вы уже знаете ответ на вопрос: „Можно ли выиграть суд с искусственным интеллектом?”. Не потому что мы навязали вам готовый вывод, а потому что двадцать реальных дел, сотни задокументированных ошибок и откровенная статистика говорят убедительнее любой рекламы. Искусственный интеллект — это мощный, доступный и действительно полезный инструмент. Но лишь инструмент. Не адвокат, не стратег и не человек, который разделит с вами последствия неверного решения.

Давайте скажем прямо то, о чём принято умалчивать. Качество работы современных ИИ-систем в юридической сфере — даже самых продвинутых, специализированных, дорогостоящих — находится в диапазоне от 58 до 73% процентов точности. Для кулинарного рецепта или подбора фильма на вечер — это отлично. Для составления документа, от которого зависит исход судебного дела, семьдесят процентов — это катастрофически мало. Потому что в суде недостающие тридцать процентов не компенсируются семидесятью правильными. Одна фиктивная ссылка, один пропущенный срок, одно неверно применённое правило — и вы теряете не тридцать процентов дела. Вы теряете всё дело. Плюс судебные издержки. Плюс время, которое уже не вернуть.

Можно ли выиграть суд с искусственным интеллектом?

Именно поэтому вопрос стоит не «адвокат или ИИ», а совсем иначе. Правильный вопрос звучит так: кто проверит работу машины? Кто возьмёт на себя ответственность за то, что документ составлен верно, сроки соблюдены, прецеденты существуют, а стратегия учитывает не только букву закона, но и живую практику конкретного суда, конкретного ведомства, конкретного инспектора? Ответ один — живой профессионал с лицензией, репутацией и личной ответственностью за результат.

Но здесь мы хотим сказать кое-что важное — то, что юридические фирмы редко говорят вслух. Использовать ИИ для первичной подготовки своего дела — это разумно. Самостоятельно изучить процедуру, понять какие документы понадобятся, разобраться в терминологии, сформулировать вопросы перед встречей с адвокатом — всё это ИИ делает хорошо, и делать это самостоятельно правильно. Вы экономите время и деньги на том этапе, где экономия оправдана. Молодцы, что пользуетесь этими возможностями.

Проблема начинается тогда, когда подготовительный этап подменяет профессиональный. Когда человек решает, что раз он уже разобрался в общих чертах — значит, разобрался достаточно. Именно здесь и происходят все катастрофы, о которых мы рассказали в этой статье. Не от глупости и не от самонадеянности — от вполне понятного желания сэкономить в ситуации, когда экономия обходится дороже всего.

Формула, которую мы предлагаем, проста. Используйте ИИ как умного и трудолюбивого помощника на этапе подготовки. Пусть он объяснит процедуру, соберёт список документов, поможет сформулировать вашу позицию, прокомментирует непонятные нормы. А потом — придите к адвокату не за тем, чтобы он сделал всё с нуля, а за тем, чтобы он проверил то, что уже сделано. Исправил ошибки. Заполнил пробелы. Добавил то, чего ИИ не знал и знать не мог — живую практику, нюансы конкретного ведомства, неписаные правила конкретного процесса. Это другой разговор — короче, предметнее и значительно дешевле, чем вести дело с нуля.

Именно такой формат работы сегодня предлагают адвокаты нового поколения. Не раскручивать клиента на проценты от выигрыша. Не брать огромные суммы авансом. Не выставлять счёт за каждое электронное письмо. А за разумное вознаграждение сделать то, что машина сделать не может: взять вашу подготовленную позицию, проверить её профессиональным взглядом и сказать — здесь всё верно, здесь нужно исправить, а вот это лучше переформулировать. И отпустить вас дальше: в суд, в МВД, в Битуах Леуми, в любое ведомство — уже с документами, за которые можно отвечать.

Наша адвокатская контора работает на израильском рынке двадцать пять лет. За это время мы видели всё: клиентов, которые приходили с идеально собранным пакетом документов и проигрывали из-за одной упущенной детали; клиентов, которые приходили почти с пустыми руками и выигрывали, потому что вовремя получили правильный совет. Разница между этими двумя историями — не в том, насколько умным был ИИ, которым они пользовались. Разница в том, нашёлся ли рядом человек, который знает не только закон, но и реальность.

Искусственный интеллект не наденет мантию израильского адвоката. Не потому что мы так хотим. А потому что мантия — это не знание текстов законов. Это ответственность. За каждое слово в документе, за каждый совет, за каждый исход. ИИ не несёт ответственности — он генерирует вероятности. А вероятности в суде — это не то же самое, что результат.

Используйте технологии. Они для этого и созданы. Но не забывайте, что у каждого инструмента есть предел его применения. Скальпель — великое изобретение. Но в руках хирурга, а не пациента, который прочитал о своей болезни в интернете. Позвольте профессионалу сделать то, за что он несёт личную ответственность. Остальное — за вами.

Если вам нужна консультация по любым вопросам, оставьте заявку прямо на этой странице или нажмите на телефон для вызова: +972 555 07 10 66

___________________________

Вам также может быть интересно: